Tout d'abord, observons que le schéma du point milieu est bien un schéma explicite à un pas constant et plus précisément, on peut réécrire $(S_{mil})$ comme

$$

y_{n+1} = y_n + h \Phi (t_n, y_h, h) \quad \text{en posant} \quad \Phi(t,x,h) = f \left( t + \frac{h}{2} , x + \frac{h}{2} f(t,x) \right) \: .

$$

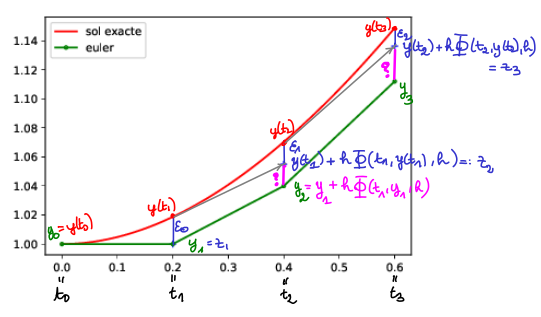

On suppose $f$ de classe $\mathrm{C}^2$ et on fixe une solution $y$ de $(E)$, qui est donc de classe $\mathrm{C}^3$, définie sur le segment $[t_0, t_0 + T] \subset I$. Soit $N \in \mathbb{N}^\ast$ et $t_0 < t_1 < \ldots < t_N = t_0 + T$ la subdivision uniforme associée de pas $h = \frac{T}{N}$. Estimons pour $n \in \{ 0, \ldots, N-1\}$ l'erreur de consistance locale du schéma du point milieu

$$

\tau_n(h) = y(t_{n+1}) - y(t_n) - h f \Big( t_n + \frac{h}{2} , y(t_n) + \frac{h}{2} \underbrace{f(t_n,y(t_n))}_{y^\prime(t_n)} \Big) \: .

$$

On va développer $\displaystyle f \Big( t_n + \frac{h}{2} , y(t_n) + \frac{h}{2} y^\prime(t_n) \Big) $ à l'ordre $2$ autour de $(t_n, y(t_n))$.

On remarque que $y$ et $y^\prime$ sont continues donc bornées par $R > 0$ sur $[t_0 , t_0 + T]$ de sorte que le segment reliant $(t_n,y(t_n))$ et $(t_n,y(t_n)) + \frac{h}{2} (1, y^\prime(t_n))$ est inclus dans un compact $[t_0, t_0 + T] \times K$ indépendant de $n$ et $h$. On note alors $M = \sup_{[t_0, t_0 + T] \times K} \| D^2 f \| > 0$.

Par l'inégalité de Taylor-Lagrange appliquée à $f$ entre $(t_n,y(t_n))$ et $(t_n,y(t_n)) + \frac{h}{2} (1, y^\prime(t_n))$, on obtient

$$

\Big| f \Big( t_n + \frac{h}{2} , y(t_n) + \frac{h}{2} y^\prime(t_n) \Big) - \underbrace{f(t_n, y(t_n))}_{y^\prime(t_n)} - \underbrace{ \frac{h}{2} \partial_1 f(t_n, y(t_n)) - \frac{h}{2} \sum_{j=2}^{d+1} y_j^\prime(t_n) \partial_j f (t_n,y(t_n)) }_{-\frac{h}{2} Df(t_n, y(t_n)) \cdot (1, y^\prime(t_n)) = -\frac{h}{2} y^{\prime\prime}(t_n)} \Big| \leq h^2 \frac{1 + \| y^\prime(t_n) \|^2}{4} M \leq C h^2 \: .

$$

On en déduit que

$$

\| \tau_n(h) \| \leq \Big| y(t_{n+1}) - y(t_n) - h \left( y^\prime(t_n) + \frac{h}{2} y^{\prime\prime}(t_n) \right) \Big| + C h^3

$$

et on conclut en appliquant l'inégalité de Taylor-Lagrange à $y$ avec reste d'ordre $3$ entre $t_n$ et $t_{n+1}$, ce qui donne

$$

\| \tau_n(h) \| \leq \frac{h^3}{3!} \sup_{[t_0, t_0 + T]} \| y^{(3)} \| + C h^3 \leq \tilde{C} h^3 \quad \Rightarrow \quad \tau(h) \leq N \tilde{C} h^3 = T \tilde{C} h^2 \: .

$$